10 月 12 日消息 語言模型(Language Model)簡單來說就是一串詞序列的概率分布,主要作用是為一個長度為 m 的文本確定一個概率分布 P,表示這段文本存在的可能性。

大家之前可能或多或少聽說過 GPT-3,OpenAI 最新的語言模型,堪稱地表最強語言模型,也被認為是革命性的人工智能模型。除此之外還有 BERT、Switch Transformer 等重量級產品,而且業內其他企業也在努力推出自家的模型。

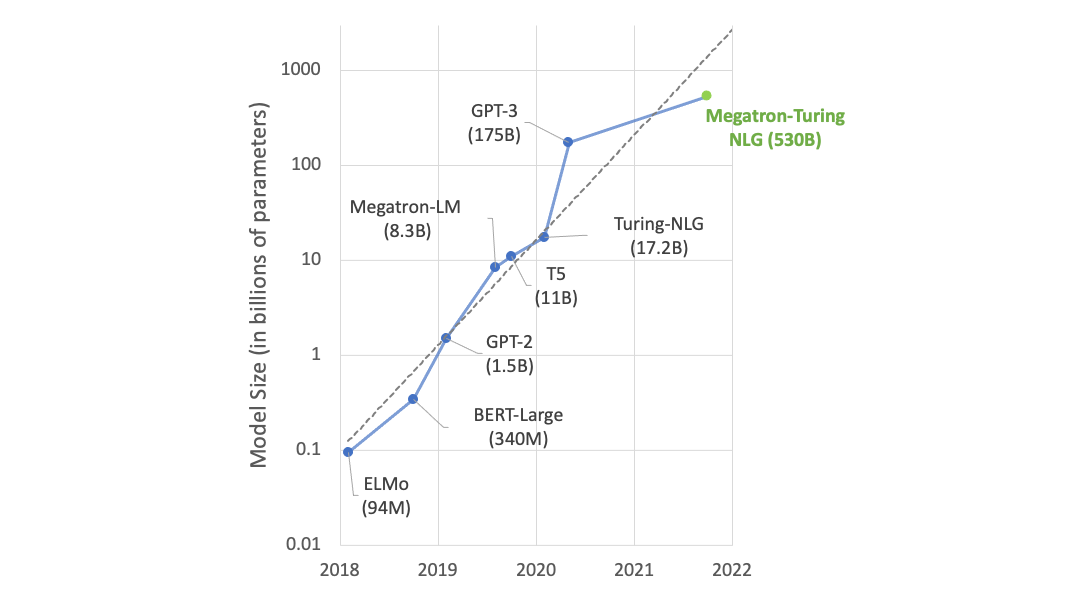

微軟和英偉達今天宣布了由 DeepSpeed 和 Megatron 驅動的 Megatron-Turing 自然語言生成模型(MT-NLG),這是迄今為止訓練的最大和最強大的解碼語言模型。

作為 Turing NLG 17B 和 Megatron-LM 的繼任者,這個模型包括 5300 億個參數,而且 MT-NLG 的參數數量是同類現有最大模型 GPT-3 的 3 倍,并在一系列廣泛的自然語言任務中展示了無與倫比的準確性,例如:

完成預測

閱讀理解

常識推理

自然語言推理

詞義消歧

105 層、基于轉換器的 MT-NLG 在零、單和少樣本設置中改進了先前最先進的模型,并為兩個模型規模的大規模語言模型設定了新標準和質量。

據悉,模型訓練是在基于 NVIDIA DGX SuperPOD 的 Selene 超級計算機上以混合精度完成的,該超級計算機由 560 個 DGX A100 服務器提供支持,這些服務器以完整的胖樹(FatTree)配置與 HDR InfiniBand 聯網。每個 DGX A100 有 8 個 NVIDIA A100 80GB Tensor Core GPU,通過 NVLink 和 NVSwitch 相互完全連接。微軟 Azure NDv4 云超級計算機使用了類似的參考架構。

特別提醒:本網信息來自于互聯網,目的在于傳遞更多信息,并不代表本網贊同其觀點。其原創性以及文中陳述文字和內容未經本站證實,對本文以及其中全部或者部分內容、文字的真實性、完整性、及時性本站不作任何保證或承諾,并請自行核實相關內容。本站不承擔此類作品侵權行為的直接責任及連帶責任。如若本網有任何內容侵犯您的權益,請及時聯系我們,本站將會在24小時內處理完畢。

站長資訊網

站長資訊網